Wprowadzenie do K- oznacza algorytm grupowania?

K- oznacza, że klastrowanie należy do algorytmu uczenia się bez nadzoru. Jest używany, gdy dane nie są zdefiniowane w grupach lub kategoriach, tj. Dane nieznakowane. Celem tego algorytmu grupowania jest wyszukiwanie i znajdowanie grup w danych, gdzie zmienna K reprezentuje liczbę grup.

Zrozumienie K- oznacza algorytm grupowania

Ten algorytm jest iteracyjnym algorytmem, który dzieli zestaw danych zgodnie z ich funkcjami na liczbę K predefiniowanych, niezachodzących na siebie odrębnych klastrów lub podgrup. Sprawia, że punkty danych między klastrami są jak najbardziej podobne, a także stara się utrzymywać klastry tak daleko, jak to możliwe. Przydziela punkty danych do klastra, jeśli suma kwadratowej odległości między środkiem ciężkości klastra a punktami danych jest minimalna, przy czym środek ciężkości klastra jest średnią arytmetyczną punktów danych znajdujących się w klastrze. Mniejsza zmienność w klastrze powoduje, że w klastrze występują podobne lub jednorodne punkty danych.

Jak działa algorytm grupowania K- oznacza?

K- oznacza algorytm grupowania wymaga następujących danych wejściowych:

- K = liczba podgrup lub klastrów

- Próbka lub zestaw szkoleniowy = (x 1, x 2, x 3, ……… x n )

Załóżmy teraz, że mamy zestaw danych, który nie jest oznakowany, i musimy podzielić go na klastry.

Teraz musimy znaleźć liczbę klastrów. Można to zrobić na dwa sposoby:

- Metoda łokciowa.

- Metoda celu.

Omówmy je w skrócie:

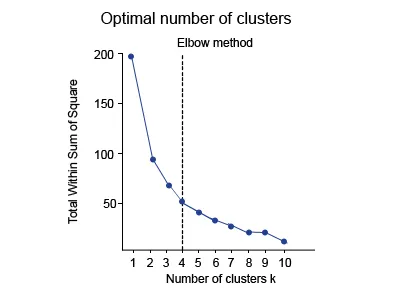

Metoda łokciowa

W tej metodzie rysowana jest krzywa między „w ramach sumy kwadratów” (WSS) a liczbą klastrów. Wykreślona krzywa przypomina ludzkie ramię. Nazywa się to metodą łokciową, ponieważ punkt łokcia na krzywej daje nam optymalną liczbę skupień. Na wykresie lub krzywej po punkcie łokciowym wartość WSS zmienia się bardzo powoli, dlatego należy wziąć pod uwagę punkt łokciowy, aby podać końcową wartość liczby skupień.

Na podstawie celu

W tej metodzie dane są dzielone na podstawie różnych wskaźników, a następnie ocenia się, jak dobrze wypadły w tym przypadku. Na przykład rozmieszczenie koszul w dziale odzieży męskiej w centrum handlowym odbywa się na podstawie kryteriów rozmiarów. Można to zrobić na podstawie ceny i marek. Wybrano najlepiej odpowiedni, aby uzyskać optymalną liczbę klastrów, tj. Wartość K.

Teraz możemy wrócić do naszego zestawu danych powyżej. Możemy obliczyć liczbę klastrów, tj. Wartość K, stosując dowolną z powyższych metod.

Jak korzystać z powyższych metod?

Zobaczmy teraz proces wykonywania:

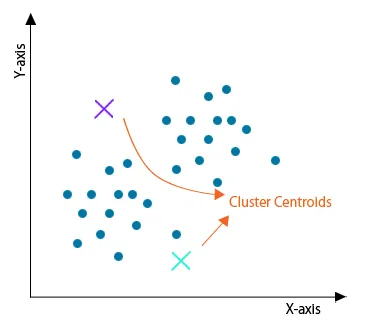

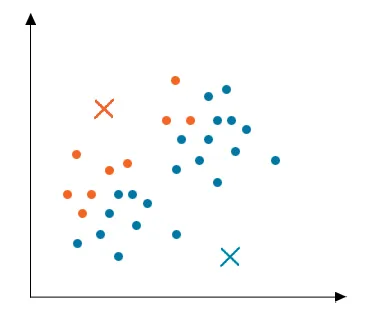

Krok 1: Inicjalizacja

Po pierwsze, zainicjuj dowolne losowe punkty zwane centroidami gromady. Podczas inicjowania należy uważać, aby centroidy klastra były mniejsze niż liczba punktów danych treningowych. Ten algorytm jest algorytmem iteracyjnym, dlatego kolejne dwa kroki są wykonywane iteracyjnie.

Krok 2: Przypisanie klastra

Po inicjalizacji wszystkie punkty danych są przemieszczane i obliczana jest odległość między wszystkimi centroidami a punktami danych. Teraz gromady będą tworzone w zależności od minimalnej odległości od centroidów. W tym przykładzie dane są podzielone na dwa klastry.

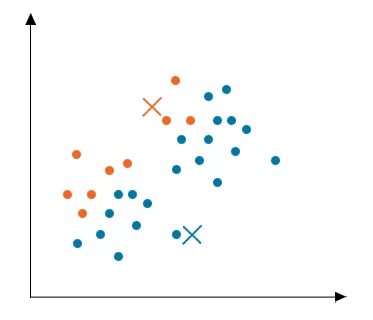

Krok 3: Przenoszenie środka ciężkości

Ponieważ klastry utworzone w powyższym etapie nie są zoptymalizowane, musimy utworzyć zoptymalizowane klastry. W tym celu musimy iteracyjnie przenieść centroidy w nowe miejsce. Weź punkty danych jednego klastra, oblicz ich średnią, a następnie przenieś środek ciężkości tego klastra do nowej lokalizacji. Powtórz ten sam krok dla wszystkich innych klastrów.

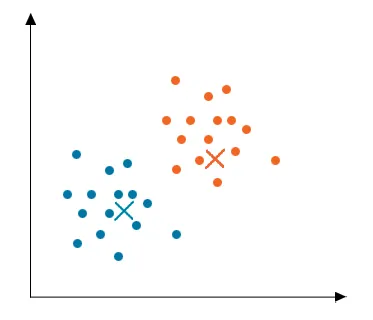

Krok 4: Optymalizacja

Powyższe dwa kroki są wykonywane iteracyjnie, aż centroidy przestaną się poruszać, tj. Nie będą już zmieniać swoich pozycji i staną się statyczne. Po wykonaniu tej czynności algorytm k- oznacza konwergencję.

Krok 5: Konwergencja

Teraz ten algorytm jest zbieżny, a odrębne klastry są tworzone i wyraźnie widoczne. Ten algorytm może dawać różne wyniki w zależności od sposobu inicjalizacji klastrów w pierwszym kroku.

Zastosowania algorytmu grupowania K-średnich

- Segmentacja rynku

- Grupowanie dokumentów

- Segmentacja obrazu

- Kompresja obrazu

- Kwantyzacja wektorowa

- Analiza skupień

- Funkcja uczenia się lub słownikowego

- Identyfikacja obszarów podatnych na przestępstwa

- Wykrywanie oszustw ubezpieczeniowych

- Analiza danych dotyczących transportu publicznego

- Grupowanie zasobów informatycznych

- Segmentacja klientów

- Identyfikacja danych rakowych

- Używany w wyszukiwarkach

- Prognozowanie aktywności leków

Zalety algorytmu grupowania K-średnich

- To jest szybkie

- Krzepki

- Łatwy do zrozumienia

- Stosunkowo wydajny

- Jeśli zestawy danych są różne, daje to najlepsze wyniki

- Twórz ściślejsze klastry

- Po ponownym obliczeniu centroidów klaster zmienia się.

- Elastyczne

- Łatwy w interpretacji

- Lepszy koszt obliczeniowy

- Zwiększa dokładność

- Działa lepiej z klastrami sferycznymi

Wady K- oznacza algorytm grupowania

- Wymaga wcześniejszej specyfikacji liczby centrów klastrów

- Jeśli istnieją dwa wysoce nakładające się dane, nie można ich rozróżnić i nie można stwierdzić, że istnieją dwa klastry

- Przy różnej reprezentacji danych osiągane wyniki są również różne

- Odległość euklidesowa może nierównomiernie obciążyć czynniki

- Daje lokalne wartości optyczne funkcji błędu kwadratu

- Czasami losowe wybranie centroidów nie może dać owocnych rezultatów

- Można użyć tylko wtedy, gdy zdefiniowano znaczenie

- Nie może obsługiwać wartości odstających i hałaśliwych danych

- Nie działa dla nieliniowego zestawu danych

- Brakuje spójności

- Wrażliwy na skalę

- W przypadku napotkania bardzo dużych zestawów danych komputer może ulec awarii.

- Problemy z prognozami

Polecane artykuły

Jest to przewodnik po algorytmie klastrowania K-Means. Tutaj omówiliśmy działanie, zastosowania, zalety i wady algorytmu klastrowania K-Means. Możesz także przejrzeć nasze inne sugerowane artykuły, aby dowiedzieć się więcej -

- Co to są sieci neuronowe?

- Co to jest eksploracja danych? | Rola eksploracji danych

- Pytanie do wywiadu Data Mining

- Uczenie maszynowe a sieć neuronowa

- Grupowanie w uczenie maszynowe