Różnica między Apache Hive i Apache Spark SQL

W związku z ogromnym wzrostem technologii dużych zbiorów danych bardzo ważne staje się stosowanie odpowiedniego narzędzia do każdego procesu. Proces ten może obejmować dowolne przetwarzanie danych, przetwarzanie danych, odzyskiwanie danych, przechowywanie danych itp. W tym poście czytamy o dwóch takich narzędziach do wyszukiwania danych: Apache Hive i Apache Spark SQL. Hive, z jednej strony, jest znany z wydajnego przetwarzania zapytań dzięki wykorzystaniu SQL-owego HQL (Hive Query Language) i jest używany do danych przechowywanych w Hadoop Distributed File System, podczas gdy Spark SQL korzysta ze strukturalnego języka zapytań i zapewnia wszystko obsługiwane są operacje odczytu i zapisu online. Hive jest znany jako składnik ekosystemu Big Data, w którym do przetwarzania danych z HDFS potrzebne są starsze programy mapujące i redukujące, podczas gdy Spark SQL jest składnikiem Apache Spark API, dzięki któremu przetwarzanie w ekosystemie Big Data jest znacznie łatwiejsze i bardziej realne -czas. Głównym błędnym przekonaniem większości dzisiejszych specjalistów jest to, że ula może być używana tylko ze starszymi technologiami i narzędziami big data, takimi jak PIG, HDFS, Sqoop, Oozie. To stwierdzenie nie jest do końca prawdziwe, ponieważ Hive jest kompatybilny nie tylko ze starszymi narzędziami, ale także z innymi komponentami opartymi na Spark, takimi jak Spark Streaming. Ideą ich użycia jest zmniejszenie wysiłku i zapewnienie lepszej wydajności dla firmy. Przyjrzyjmy się szczegółowo zarówno Apache Hive, jak i Apache Spark SQL.

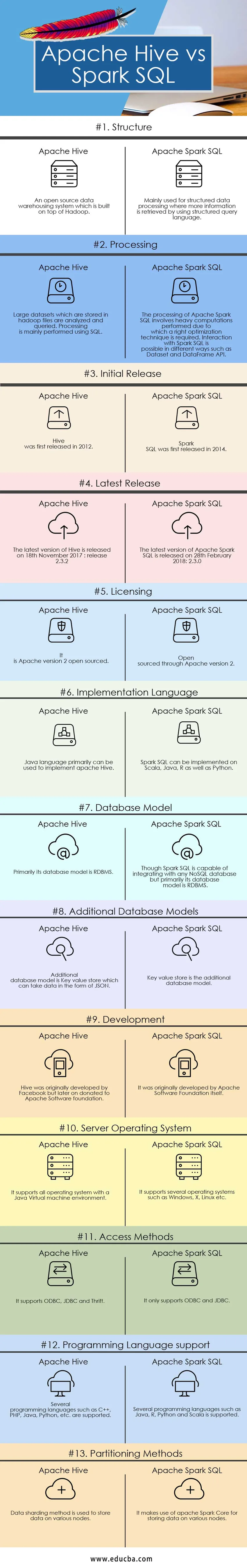

Bezpośrednie porównanie Apive Hive vs Apache Spark SQL (infografiki)

Poniżej znajduje się porównanie 13 najlepszych między Apache Hive a Apache Spark SQL

Kluczowe różnice między Apache Hive a Apache Spark SQL

Kluczowe różnice między Apache Hive a Apache Spark SQL

Różnice między Apache Hive i Apache Spark SQL omówiono w poniższych punktach:

- Hive jest znany z używania HQL (Hive Query Language), podczas gdy Spark SQL wykorzystuje język Structured Query do przetwarzania i zapytań o dane

- Hive zapewnia elastyczność schematu, porcjowanie i grupowanie tabel, podczas gdy Spark SQL wykonuje zapytania SQL, możliwe jest jedynie odczytanie danych z istniejącej instalacji Hive.

- Hive zapewnia prawa dostępu dla użytkowników, ról i grup, podczas gdy Spark SQL nie zapewnia żadnej funkcji zapewniającej prawa dostępu dla użytkownika

- Hive udostępnia funkcję selektywnego współczynnika replikacji do redundantnego przechowywania danych, podczas gdy Spark SQL z drugiej strony nie zapewnia żadnego współczynnika replikacji do przechowywania danych

- Ponieważ sterowniki JDBC, ODBC i oszczędzania są dostępne w Hive, możemy ich używać do generowania wyników, natomiast w przypadku Apache Spark SQL możemy pobierać wyniki w postaci zestawów danych i interfejsów API DataFrame, jeśli Spark SQL jest uruchamiany z innym językiem programowania

- Istnieje kilka ograniczeń:

- Aktualizacje na poziomie wiersza i zapytania OLTP w czasie rzeczywistym nie są możliwe przy użyciu Apache Hive, natomiast aktualizacje na poziomie wiersza i przetwarzanie transakcji online w czasie rzeczywistym są możliwe przy użyciu Spark SQL.

- Zapewnia akceptowalne wysokie opóźnienie dla interaktywnego przeglądania danych, podczas gdy w Spark SQL podane opóźnienie jest minimalne, aby zwiększyć wydajność.

- Hive, podobnie jak instrukcje i zapytania SQL, obsługuje typ UNION, natomiast Spark SQL nie jest w stanie obsługiwać typu UNION.

Apache Hive vs Apache Spark SQL Tabela porównawcza

| Podstawa porównania | Apache Hive | Apache Spark SQL |

| Struktura | System hurtowni danych typu open source zbudowany na platformie Hadoop | Używany głównie do przetwarzania danych strukturalnych, gdzie więcej informacji jest pobieranych przy użyciu języka zapytań strukturalnych. |

| Przetwarzanie | Duże zestawy danych przechowywane w plikach hadoop są analizowane i sprawdzane. Przetwarzanie odbywa się głównie za pomocą SQL. | Przetwarzanie Apache Spark SQL wymaga wykonywania ciężkich obliczeń, dzięki którym wymagana jest odpowiednia technika optymalizacji. Interakcja z Spark SQL jest możliwa na różne sposoby, takie jak Dataset i DataFrame API. |

| Pierwsze wydanie | Hive został wydany po raz pierwszy w 2012 roku | Spark SQL został wydany po raz pierwszy w 2014 roku |

| Najnowsze wydanie | Najnowsza wersja Hive została wydana 18 listopada 2017 r .: wydanie 2.3.2 | Najnowsza wersja Apache Spark SQL została wydana 28 lutego 2018 r .: 2.3.0 |

| Koncesjonowanie | Jest to wersja open source Apache 2 | Otwórz za pośrednictwem Apache w wersji 2 |

| Język implementacji | Język Java może być przede wszystkim używany do implementacji Apache Hive | Spark SQL może być zaimplementowany na Scali, Javie, R oraz Pythonie |

| Model bazy danych | Model bazy danych to przede wszystkim RDBMS | Chociaż Spark SQL jest zdolny do integracji z dowolną bazą danych NoSQL, ale przede wszystkim jego modelem bazy danych jest RDBMS |

| Dodatkowe modele baz danych | Dodatkowy model bazy danych to magazyn kluczy i wartości, który może przyjmować dane w postaci JSON | Magazyn klucz-wartość to dodatkowy model bazy danych |

| Rozwój | Hive został pierwotnie opracowany przez Facebooka, ale później przekazany na rzecz fundacji Apache Software | Został pierwotnie opracowany przez samą Apache Software Foundation |

| System operacyjny serwera | Obsługuje wszystkie systemy operacyjne ze środowiskiem wirtualnej maszyny Java | Obsługuje kilka systemów operacyjnych, takich jak Windows, X, Linux itp. |

| Metody dostępu | Obsługuje ODBC, JDBC i Thrift | Obsługuje tylko ODBC i JDBC |

| Obsługa języka programowania | Obsługiwanych jest kilka języków programowania, takich jak C ++, PHP, Java, Python itp | Obsługiwanych jest kilka języków programowania, takich jak Java, R, Python i Scala |

| Metody partycjonowania | Metoda dzielenia danych służy do przechowywania danych w różnych węzłach | Wykorzystuje Apache Spark Core do przechowywania danych w różnych węzłach |

Wniosek - Apache Hive vs. Apache Spark SQL

Nie możemy powiedzieć, że Apache Spark SQL zastępuje Hive i vice versa. Po prostu Spark SQL może być postrzegany jako przyjazny dla programistów interfejs API oparty na Spark, którego celem jest ułatwienie programowania. Hive ma specjalną zdolność do częstego przełączania między silnikami, a zatem jest wydajnym narzędziem do wyszukiwania dużych zestawów danych. Wykorzystanie i wdrożenie w zależności od wyboru zależy od twoich celów i wymagań. Zarówno Apache Hive, jak i Apache Spark SQL są graczami we własnej dziedzinie. Mam nadzieję, że po przejściu przez pocztę uzyskasz dość rzetelny obraz potrzeb organizacji. Śledź naszego bloga, aby uzyskać więcej takich postów, a my zapewniamy informacje, które wspierają Twój biznes.

Polecany artykuł

Jest to przewodnik po Apache Hive vs Apache Spark SQL, ich znaczeniu, porównaniu bezpośrednim, kluczowych różnicach, tabeli porównawczej i wnioskach. Możesz także przejrzeć następujące artykuły, aby dowiedzieć się więcej -

- Różnice między Java a węzłem JS

- Apache Pig vs Hoje Apache - Top 12 przydatnych różnic

- Hadoop vs Hive - Znajdź najlepsze różnice

- 7 ważnych pomocnych rzeczy na temat Apache Spark (przewodnik)

- Apache Hadoop vs Apache Spark | 10 najlepszych porównań, które musisz znać!

- Używanie funkcji ORDER BY w gałęzi