Wprowadzenie do klasyfikacji sieci neuronowej

Sieci neuronowe są najbardziej wydajnym sposobem (tak, dobrze przeczytałeś), aby rozwiązać rzeczywiste problemy sztucznej inteligencji. Obecnie jest to również jeden z szeroko zakrojonych badań w dziedzinie informatyki, w którym podczas czytania tego artykułu opracowano by nową formę sieci neuronowej. Istnieją setki sieci neuronowych do rozwiązywania problemów specyficznych dla różnych domen. Tutaj przeprowadzimy Cię przez różne typy podstawowych sieci neuronowych w kolejności rosnącej złożoności.

Różne rodzaje podstaw w klasyfikacji sieci neuronowych

1. Shallow Neural Networks (Collaborative Filtering)

Sieci neuronowe zbudowane są z grup Perceptronu w celu symulacji struktury neuronowej ludzkiego mózgu. Płytkie sieci neuronowe mają jedną ukrytą warstwę perceptronu. Jednym z typowych przykładów płytkich sieci neuronowych jest Filtrowanie kooperacyjne. Ukryta warstwa perceptronu byłaby trenowana do reprezentowania podobieństw między bytami w celu generowania rekomendacji. System rekomendacji w serwisach Netflix, Amazon, YouTube itp. Korzysta z wersji filtrowania grupowego, aby polecać swoje produkty zgodnie z zainteresowaniami użytkowników.

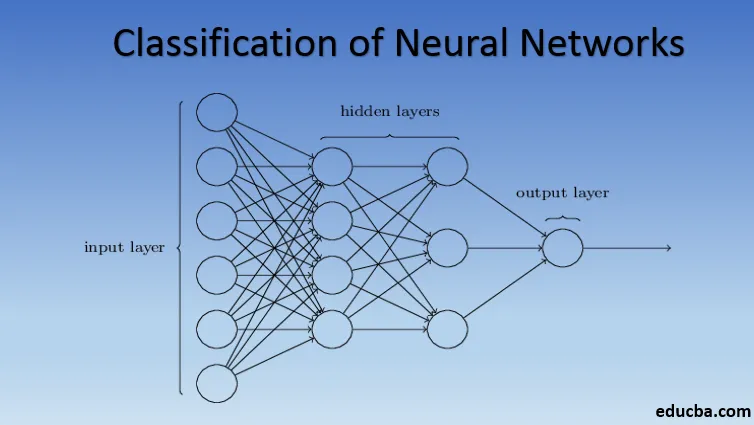

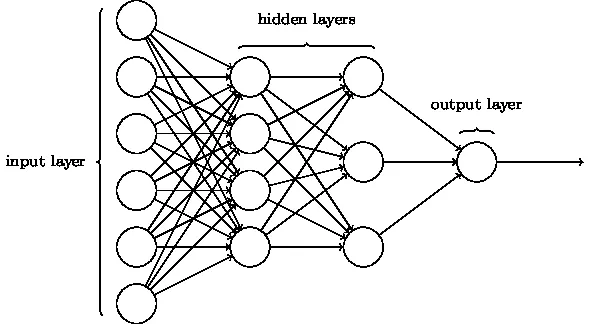

2. Perceptron wielowarstwowy (głębokie sieci neuronowe)

Sieci neuronowe z więcej niż jedną ukrytą warstwą nazywane są głębokimi sieciami neuronowymi. Spoiler Alert! Wszystkie następujące sieci neuronowe są formą poprawionej / ulepszonej głębokiej sieci neuronowej w celu rozwiązania problemów specyficznych dla domeny. Zasadniczo pomagają nam osiągnąć uniwersalność. Biorąc pod uwagę wystarczającą liczbę ukrytych warstw neuronu, głęboka sieć neuronowa może aproksymować, tj. Rozwiązać każdy złożony problem w świecie rzeczywistym.

Twierdzenie o aproksymacji uniwersalnej jest rdzeniem głębokich sieci neuronowych do trenowania i dopasowywania dowolnego modelu. Każda wersja głębokiej sieci neuronowej jest rozwijana przez w pełni połączoną warstwę maksymalnego sumowanego iloczynu macierzy, który jest optymalizowany przez algorytmy propagacji wstecznej. Będziemy nadal uczyć się ulepszeń prowadzących do różnych form głębokich sieci neuronowych.

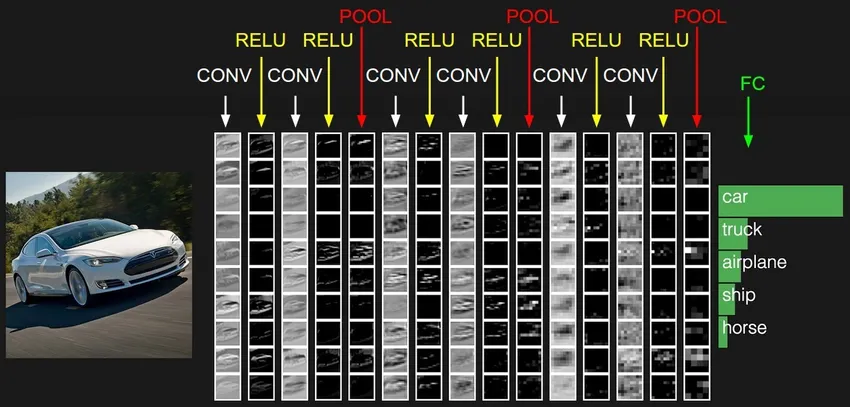

3. Konwolucyjna sieć neuronowa (CNN)

CNN są najbardziej dojrzałą formą głębokich sieci neuronowych, umożliwiającą uzyskanie najdokładniejszych, tj. Lepszych niż ludzkie, wyników w obrazie komputerowym. Sieci CNN składają się z warstw zwojów utworzonych przez skanowanie każdego piksela obrazów w zbiorze danych. Gdy dane są przybliżane warstwa po warstwie, CNN zaczyna rozpoznawać wzorce, a tym samym rozpoznawać obiekty na obrazach. Obiekty te są szeroko stosowane w różnych aplikacjach do identyfikacji, klasyfikacji itp. Ostatnie praktyki, takie jak uczenie się przez przenoszenie w sieciach CNN, doprowadziły do znacznej poprawy niedokładności modeli. Google Translator i Google Lens są najnowocześniejszymi przykładami CNN.

Zastosowanie CNN ma charakter wykładniczy, ponieważ są one nawet wykorzystywane w rozwiązywaniu problemów, które nie są związane przede wszystkim z widzeniem komputerowym. Bardzo proste, ale intuicyjne wyjaśnienie CNN można znaleźć tutaj.

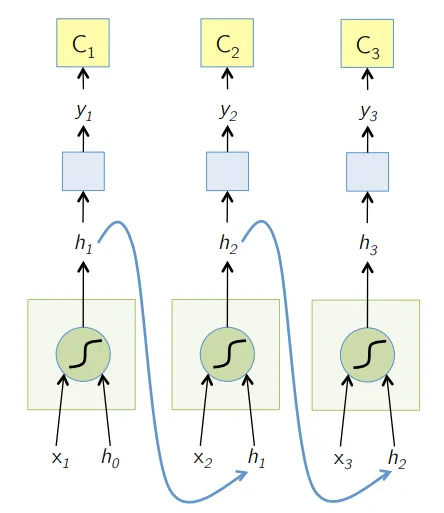

4. Recurrent Neural Network (RNN)

RNN są najnowszą formą głębokich sieci neuronowych do rozwiązywania problemów w NLP. Mówiąc najprościej, sieci RNN przesyłają dane wyjściowe kilku ukrytych warstw z powrotem do warstwy wejściowej, aby agregować i przekazywać przybliżenie do następnej iteracji (epoki) wejściowego zestawu danych. Pomaga również modelowi w nauce i szybciej koryguje prognozy. Takie modele są bardzo pomocne w zrozumieniu semantyki tekstu w operacjach NLP. Istnieją różne warianty RNN, takie jak Long Short Term Memory (LSTM), Gated Recurrent Unit (GRU) itp. Na poniższym schemacie aktywacja z h1 i h2 jest zasilana odpowiednio wejściami x2 i x3.

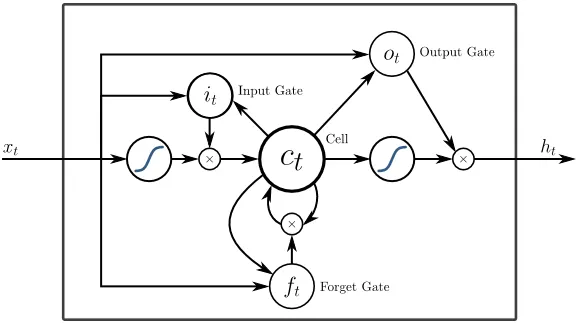

5. Długotrwała pamięć krótkotrwała (LSTM)

LSTM są zaprojektowane specjalnie w celu rozwiązania problemu znikających gradientów z RNN. Znikające gradienty zdarzają się w dużych sieciach neuronowych, w których gradienty funkcji utraty zbliżają się do zera, co powoduje zatrzymywanie uczenia się sieci neuronowych. LSTM rozwiązuje ten problem, zapobiegając funkcjom aktywacji w swoich powtarzających się komponentach i usuwając mutacje z przechowywanych wartości. Ta niewielka zmiana dała duże ulepszenia w ostatecznym modelu, w wyniku czego giganci technologii dostosowali LSTM do swoich rozwiązań. Przejdźmy do „najprostszej, zrozumiałej” ilustracji LSTM,

6. Sieci oparte na uwagach

Uwaga modele powoli przejmują w praktyce nawet nowe RNN. Modele uwagi są budowane przez skupienie się na części podzbioru przekazywanych informacji, eliminując w ten sposób przytłaczającą ilość informacji w tle, które nie są potrzebne dla danego zadania. Modele uwagi są zbudowane z połączenia miękkiej i twardej uwagi oraz dopasowania poprzez propagację miękkiej uwagi z powrotem. Wiele modeli uwagi ułożonych hierarchicznie nazywa się Transformatorem. Transformatory te są bardziej wydajne w równoległym stosowaniu stosów, dzięki czemu zapewniają najnowocześniejsze wyniki przy stosunkowo mniejszych danych i czasie na szkolenie modelu. Dystrybucja uwagi staje się bardzo potężna, gdy jest używana z CNN / RNN i może generować opis tekstowy na obrazie w następujący sposób.

Giganci technologiczni, tacy jak Google, Facebook itp., Szybko dostosowują modele uwagi do budowania swoich rozwiązań.

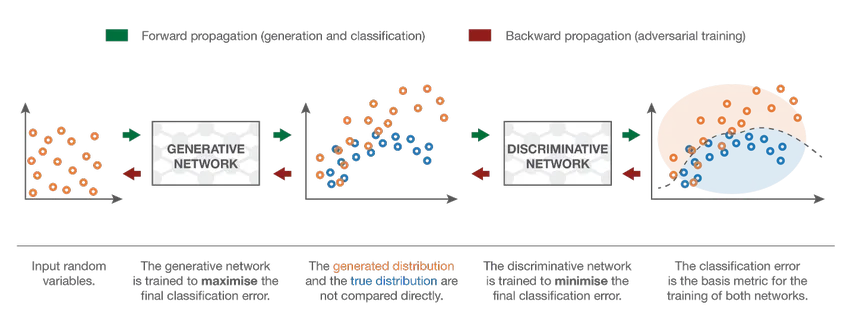

7. Generative Adversarial Network (GAN)

Chociaż modele głębokiego uczenia zapewniają najnowsze wyniki, można je oszukać o wiele bardziej inteligentnych ludzkich odpowiedników, dodając szum do rzeczywistych danych. Sieci GAN są najnowszym osiągnięciem w dziedzinie głębokiego uczenia się, umożliwiającym radzenie sobie z takimi scenariuszami. Sieci GAN wykorzystują uczenie bez nadzoru, w którym głębokie sieci neuronowe są szkolone z danymi generowanymi przez model AI wraz z rzeczywistym zestawem danych w celu poprawy dokładności i wydajności modelu. Te przeciwne dane są najczęściej wykorzystywane do oszukiwania modelu dyskryminacyjnego w celu zbudowania optymalnego modelu. Powstały model wydaje się być lepszym przybliżeniem niż może pokonać taki hałas. Zainteresowanie badawcze GAN doprowadziło do bardziej wyrafinowanych wdrożeń, takich jak GAN warunkowy (CGAN), GAN Laplacian Pyramid (LAPGAN), GAN Super Resolution GAN (SRGAN) itp.

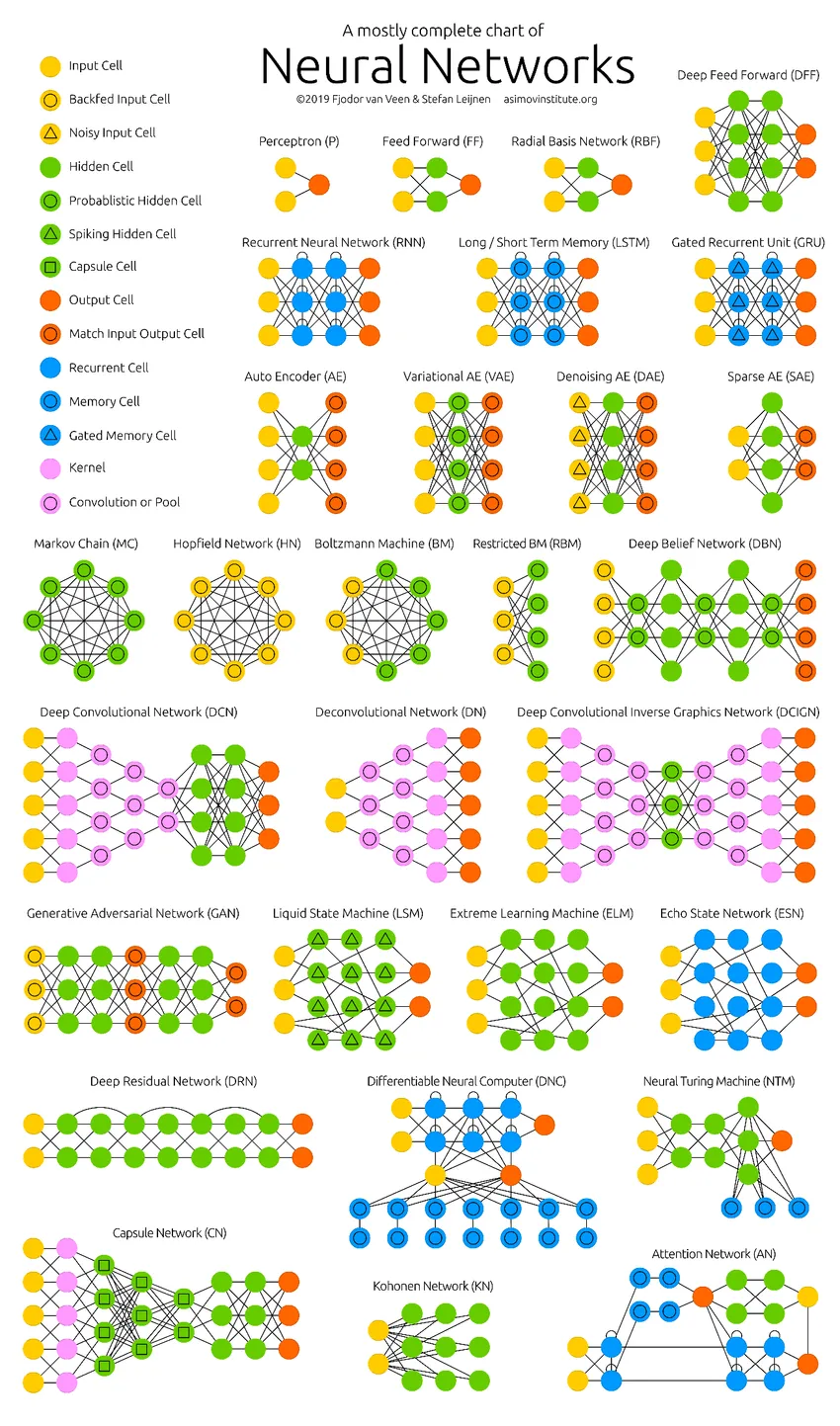

Wniosek - klasyfikacja sieci neuronowej

Głębokie sieci neuronowe przekraczają granice komputerów. Nie ograniczają się one tylko do klasyfikacji (CNN, RNN) lub prognoz (Filtrowanie współpracy), ale nawet do generowania danych (GAN). Dane te mogą różnić się od pięknej formy sztuki po kontrowersyjne głębokie podróbki, ale każdego dnia przewyższają ludzi o jedno zadanie. Dlatego powinniśmy również wziąć pod uwagę etykę i wpływ AI podczas ciężkiej pracy nad zbudowaniem wydajnego modelu sieci neuronowej. Czas na zgrabną infografikę o sieciach neuronowych.

Polecane artykuły

To jest przewodnik po klasyfikacji sieci neuronowej. Tutaj omówiliśmy różne typy podstawowych sieci neuronowych. Możesz również przejrzeć nasze podane artykuły, aby dowiedzieć się więcej-

- Co to są sieci neuronowe?

- Algorytmy sieci neuronowej

- Narzędzia do skanowania sieciowego

- Recurrent Neural Networks (RNN)

- Top 6 porównań między CNN a RNN